LLM API:2025年的应用场景、工具与最佳实践 - Orq.ai

近年来,内容生成、问题解答以及复杂对话中展现了卓越的能力。

LLM的发展历程可以追溯到早期的客户服务自动化、动态内容创建和高级研究工具等领域的应用更加广泛。

随着企业加速将LLM APIs的应用场景、工具及最佳实践。

了解LLM APIs

应用程序编程接口(API)是连接不同软件应用程序的桥梁,使开发者能够轻松集成LLM功能。通过LLM API,企业无需从零开始构建模型,即可利用强大的人工智能工具,快速部署内容生成、问答系统等解决方案。

使用LLM APIs的显著优势之一是其可扩展性。企业可以根据需求灵活调整使用规模,从而实现成本效益。诸如Google AI API和Mistral AI API等供应商提供基于代币的灵活定价模型,使企业能够高效管理预算,同时最大化AI的潜力。

此外,LLM AI驱动应用的上市时间。例如,Meta Llama API和IBM Granite API等提供商提供了适用于多个行业的强大工具,从客户服务自动化到研究分析。此外,通过优化令牌使用,API调用效率得以提升,同时避免了不必要的开支。

通过这些API,企业不仅能够提升运营效率,还能推动创新,在人工智能驱动的转型中占据领先地位。

LLM APIs的流行使用案例

内容创作与营销

LLM APIs正在彻底改变内容创作和营销方式。通过自动化写作任务,企业能够大幅提升内容生产效率,同时保持高质量输出。这种方式有助于提高生产力、增强用户参与度,并提升数字平台的转化率。

客户服务增强

通过自动化和优化客户交互,LLM APIs在提升客户服务效率方面发挥了重要作用。企业能够借助其实现全天候服务,从而改善用户体验。

软件开发支持

LLM APIs为开发者提供了强大的支持工具,能够优化代码生成、调试和文档编制等任务,从而提升开发效率。

业务运营优化

通过自动化文档处理和决策流程,LLM APIs帮助企业简化业务操作,提升整体效率。

教育工具

LLM APIs为教育领域带来了个性化学习体验和自动化内容生成工具,正在改变传统的教育模式。

创造性努力

在艺术创作、设计和内容生成等领域,LLM APIs为创意工作者提供了全新的工具和灵感来源。

研究与分析工具

LLM APIs能够处理复杂的数据集,为研究人员提供强大的分析能力和洞察支持。

个人生产力辅助工具

通过集成LLM APIs,个人用户可以获得智能助手支持,从而提升日常工作的效率。

实施LLM APIs的挑战与注意事项

尽管LLM功能强大,但其集成过程中仍存在一些挑战。以下是企业在实施LLM APIs时需要注意的关键问题:

数据隐私与安全

LLM的训练需要大量数据,其中可能包含敏感信息。因此,确保数据在传输和存储过程中的安全性至关重要。企业应选择符合GDPR、CCPA等法规的API提供商,并考虑使用私有云部署以增强数据控制。

伦理问题与模型偏差

LLM可能因训练数据中的偏差而产生不公平的结果。企业应采取措施检测和纠正模型偏差,例如使用精心策划的数据集进行微调,并定期审计模型输出。

质量控制与输出一致性

LLM生成的内容可能存在不一致或不准确的情况。企业应建立监控机制,定期评估模型输出质量,并根据反馈优化提示设计。

模型维护与适应

随着AI技术的快速发展,企业需要不断调整和优化LLM APIs的使用,以适应新需求。这包括更新模型、微调参数以及规划解决方案的可扩展性。

成本管理

LLM APIs的使用成本可能随着调用频率的增加而迅速上升。企业应优化API调用,选择合适的定价模型,并利用代币优化技术以控制预算。

集成复杂性

将LLM APIs集成到现有系统中可能面临技术挑战。企业应遵循最佳实践,充分利用供应商提供的SDK和工具,以简化集成过程。

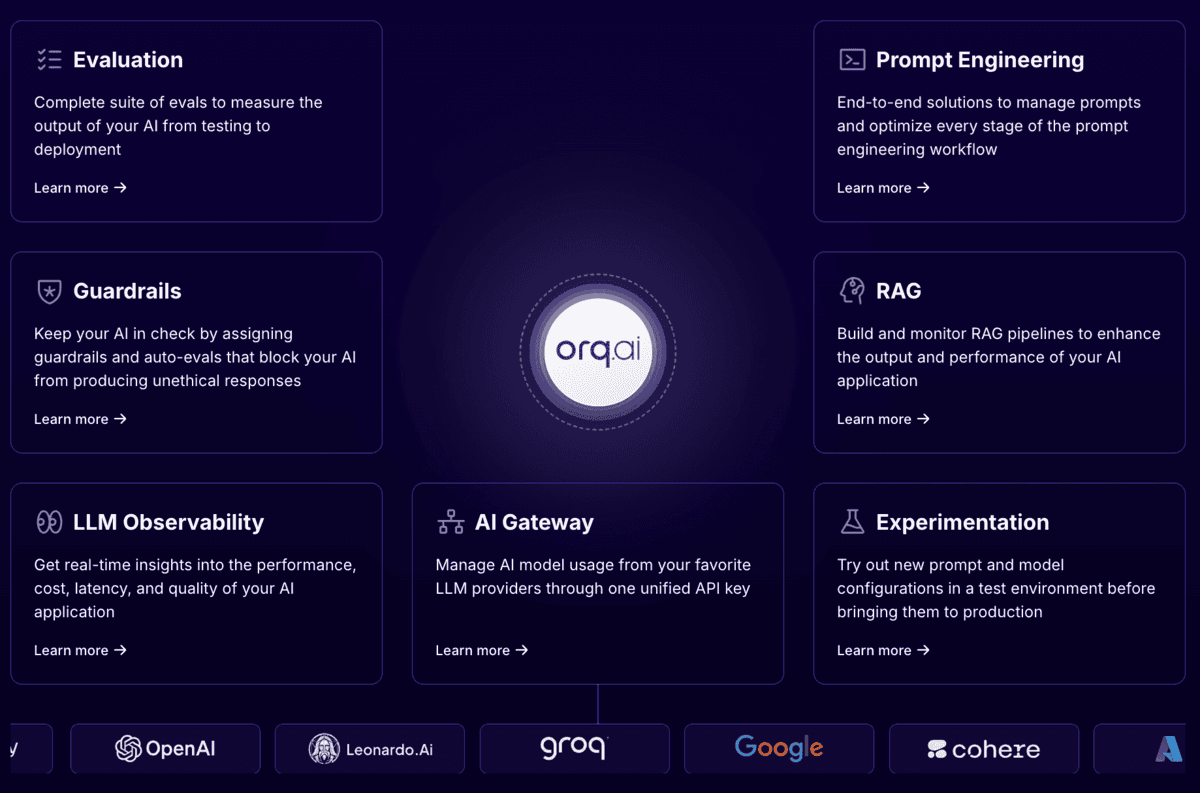

Orq.ai:LLM API管理的LLMOps平台

Orq.ai是一个专为简化LLM API管理而设计的LLMOps平台,帮助团队高效构建、部署和优化生成型AI应用。

核心能力:

- 生成型AI网关:支持与130多个顶级LLM模型的无缝集成,便于团队在统一平台上选择最佳模型。

- 游乐场与实验:提供受控环境,用于测试和比较不同模型及提示配置。

- AI部署:通过护栏、回退模型和回归测试,确保应用从开发到生产的平稳过渡。

- 可观察性与评估:实时监控AI性能,通过详细日志和仪表板优化模型。

- 安全与隐私:符合SOC2认证和GDPR法规,确保数据安全性和合规性。

总结

大型企业的运营方式,为内容生成、客户服务等领域提供了强大的解决方案。通过集成LLM APIs,企业能够提升效率、推动创新,并在数字化转型中占据优势。然而,数据隐私、伦理问题以及成本管理等挑战需要引起足够重视。

Orq.ai等平台通过提供全面的工具和支持,简化了LLM API的管理和优化过程,使企业能够高效、安全地部署AI解决方案。在未来,随着技术的不断进步,LLM APIs将继续为企业带来更多可能性。

原文链接: https://orq.ai/blog/llm-api-use-cases