Together API × Axiomic:构建多智能体聊天系统的实践指南

文章目录

一. Together API 与多智能体工作流

在 Together AI 中,客户和合作伙伴越来越多地利用 Together API 构建多智能体工作流和应用。凭借行业领先的性能和多模型能力,Together Inference 成为基于智能体工作流的领先解决方案。

最近,我们与 Axiomic 合作,将 Together API 集成到其核心框架中,作为开源模型的提供商。这使得开发者能够利用模块化智能体构建高效、可调试的 AI 应用。

本文将介绍如何使用 Axiomic 的演示项目 GEAR Chat 构建多智能体协作的聊天系统,展示四个智能体如何协同工作,实现可移植、可操控和可调试的智能体架构。

二. Axiomic框架

Axiomic 是一个专注于多智能体协作的 AI 框架,其核心目标是通过模块化设计和开源模型支持,简化复杂 AI 应用的开发过程。它与 Together API 深度集成,为开发者提供灵活、高效的智能体构建工具。

三. GEAR Chat演示

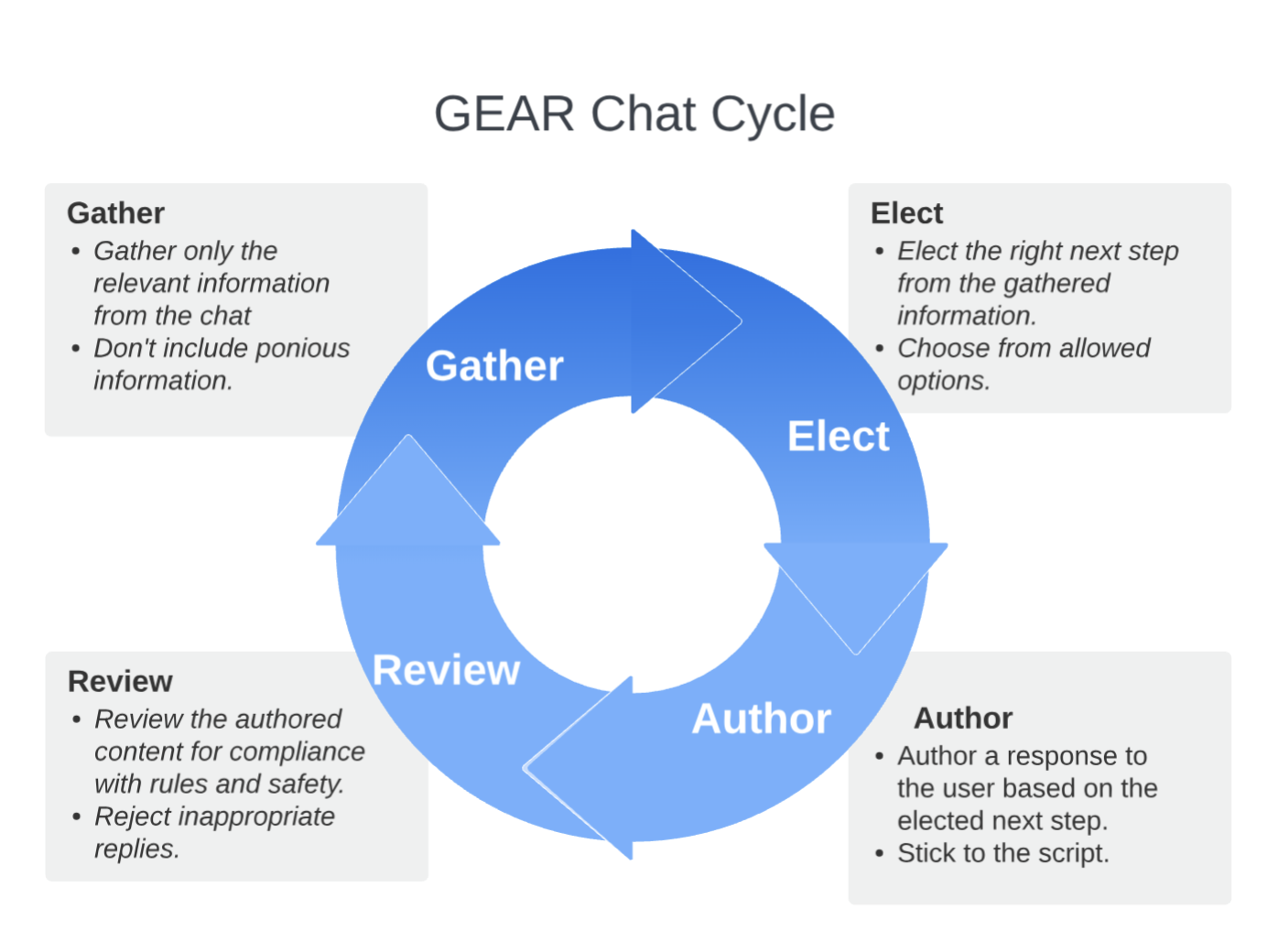

GEAR Chat 是 Axiomic 框架中的演示项目,展示了四个智能体协作工作:生成(Generate)、选举(Elect)、创作(Author)和审查(Review)。每个智能体专注于特定任务,从而提升系统的可操控性和可靠性。

1. 多智能体架构优势

相比单一推理方式,多智能体架构具有以下优势:

a. 可操控性

每个智能体专注于特定任务,便于调试和优化。

b. 可移植性

通过分解任务,可以灵活使用不同的模型,支持从小型开源模型到大型闭源模型。

c. 可靠性

减少复杂提示的使用,降低模型误解或偏差风险,提高整体系统稳定性。

例如,将复杂提示拆分为多个智能体,可以使用较小开源模型替代大型闭源模型,从而降低成本并提升灵活性。

2. 四个智能体的功能

- 收集(Gather):从聊天中提取关键信息,以结构化方式报告,确保后续步骤聚焦于正确信息。

- 选举(Elect):根据收集的信息决定下一步行动,严格限定决策空间。

- 创作(Author):将选定的行动转化为用户响应,确保符合指令。

- 审查(Review):为创作智能体结果提供护栏,避免生成不合适内容。

3. 动态调整与多模型支持

GEAR Chat 的灵活性体现在:

只需更改提示文件(无需重新编码),即可创建多种聊天智能体。这些智能体可运行于多种模型上,支持从小型开源模型到大型闭源模型的广泛选择。

四. 深度示例:发布到哪?聊天

GEAR Chat 的一个具体示例是“发布到哪?”,通过幽默方式帮助用户决定社交媒体发布位置。每个智能体在该示例中的功能如下:

Elect 智能体示例代码:

class ElectAgent:

def __init__(self, elect_examples):

self.examples = [(e.user, e.agent) for e in elect_examples]

self.switch = axi.core.modules.Switch(self.examples)

def infer(self, text):

case_name = self.switch.infer(text).value_json()

return case_name在此示例中,Elect 智能体负责多类文本分类任务,借助 Together API 的多模型能力轻松评估性能。

五. Together AI上的Elect智能体评估

在 Axiomic 中,评估多个模型非常简单。示例代码如下:

eval_model_list = [

models.Together.Text.Llama3.llama_3_8b_hf,

models.Together.Text.CodeLlama.codellama_70b_instruct_hf,

models.Together.Text.Llama3.llama_3_70b_chat_hf,

# ... 更多模型 ...

]

for model in eval_model_list:

with model:

print(evaluate_elect_agent(chat, elect_eval_examples))通过这种方式,开发者可快速比较不同模型性能,根据预算和质量需求选择最适合的模型。

1. 评估结果

实际评估显示,不同模型在 Elect 智能体任务上的表现差异显著。参数规模从 34B 到 72B 的模型表现优异,而小型模型(如 Llama-3-8B)也展现出出色性能。灵活性允许开发者根据实际需求选择合适模型。

六. 展望未来

Axiomic 与 Together API 的结合展示了开源 AI 生态系统的巨大潜力。通过模块化、多智能体设计,开发者能够高效构建复杂 AI 应用。未来,随着工具生态系统完善,我们期待更多创新的多步骤 AI 应用落地。